Sora模型原理解析!

OpenAI Sora文生视频模型一经亮相再次沸腾了整个AI 圈,也是ChatGPT掀起GenAI热潮时隔一年后,OpenAI再次史诗级的更新。随后,OpenAI公布的技术综述[文献1]: 视频生成模型作为世界模拟器,更是充分展现了其勃勃雄心,这无疑为AI领域注入了新的活力与期待。

本文总结了 Open AI的训练思路以及 Sora 详细的技术特性及模型原理,简单来说, Sora 将所有类型的时空视觉数据转换为统一的表示(将视频压缩到一个低维的潜变量空间,然后将其拆解为时空碎片Spacetime Latent Patches),在大规模的训练量下也产生了类似涌现的能力。

技术特点

三维空间的连贯性:Sora具备出色的能力,能够生成带有动态相机运动的视频。在相机的移动和旋转过程中,人物和场景元素在三维空间中呈现出流畅而连贯的运动,为用户带来身临其境的体验。可以看到,相比于其他三个视频生成模型,Sora 在生成时长、连贯性等方面都有显著的优势。

模拟数字世界:Sora不仅限于生成静态视频,更能模拟数字世界中的动态过程。它可以精准地控制视频游戏中的玩家,并高保真地渲染游戏世界及其动态。值得一提的是,通过提及“Minecraft”这一经典游戏,我们可以轻松激发Sora的这些卓越能力,使其在游戏中展现出色的表现。

长期连续性和物体持久性:对于视频生成系统而言,Sora展现出卓越的长期连续性和物体持久性。它能够有效地模拟短期和长期的依赖关系,确保生成的视频在时间上保持连贯。此外,Sora还能在一个样本中生成同一角色的多个镜头,并保证其在整个视频中的外观保持一致,从而增强了角色的辨识度和可信度。

与世界互动:Sora在某些情况下还能够模拟与世界状态产生简单影响的行为。例如,画家可以在画布上留下随时间持续的新笔触,展现出创作的动态过程;或者一个人吃汉堡时,Sora能够准确地模拟咬痕的形成,呈现出真实的互动效果。这些细节的呈现使得生成的视频更加生动真实,为用户带来更加沉浸式的视觉体验。

训练过程

Sora 的训练受到了大语言模型(Large Language Model)的启发。这些模型通过在互联网规模的数据上进行训练,从而获得了泛化能力。

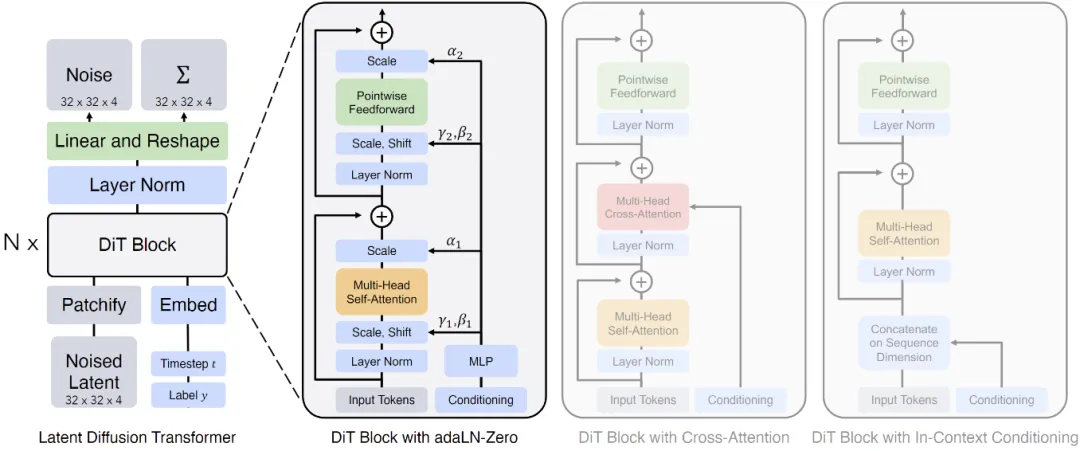

Sora实际上是一个Diffusion+Transformer模型,通过扩散模型与 Transformer,组合成强大的信息提取器。在用于从高维的时空碎片张成的空间中,观察并提取丰富的时空碎片之间的关联与演化的动态过程。这来自伯克利学者的工作Diffusion Transformer (DiT):”采用Transformer的可扩展扩散模型-Scalable diffusion models with transformers”,整体架构如下:

Diffusion Transformer (DiT)架构。左:我们训练调节的潜DiT模型。输入潜变量被分解成几个patch并由几个DiT块处理。右:DiT块的细节。我们对标准Transformer的变体进行了实验,这些变体通过自适应层归一化、交叉注意力和额外的输入token做调节。自适应层归一化效果最好。

首先将视频压缩到一个低维潜在空间中,然后将这种表现形式分解成时空区块,从而将视频转换为区块。

训练了一个用于降低视觉数据维度的网络。这个网络以原始视频为输入,输出在时间和空间上都被压缩的潜在表示。Sora在这个压缩的潜在空间上进行训练,并在此空间中生成视频。还开发了一个对应的解码器模型,它能将生成的潜在表示映射回到像素空间。

对于给定的压缩输入视频,提取一系列时空区块,它们在变换器模型中充当标记(token)。这种方案同样适用于图像,因为图像本质上是单帧的视频。基于区块的表示方法使Sora能够针对不同分辨率、持续时间和纵横比的视频和图像进行训练。在推理过程中,可以通过在适当大小的网格中排列随机初始化的区块来控制生成视频的大小。

随着 Sora 训练计算量的增加,样本质量有了显著提升。Sora训练时没有对素材进行裁切,使得Sora能够直接为不同设备以其原生纵横比创造内容。针对视频的原生纵横比进行训练,还可以提高构图和取景的质量。

训练文本到视频的生成系统需要大量配有相应文本提示的视频。应用了在DALL·E 3中引入的重新字幕技术到视频上。与DALL·E 3相似,也利用了GPT技术,将用户的简短提示转换成更详细的提示,然后发送给视频模型。

论文关键点

OpenAI 的研究论文《Video generation models as world simulators》探讨了在视频数据上进行大规模训练生成模型的方法。这项研究特别关注于文本条件扩散模型,这些模型同时在视频和图像上进行训练,处理不同时长、分辨率和宽高比的数据。研究中提到的最大模型 Sora 能够生成长达一分钟的高保真视频。以下是论文的一些关键点:

统一的视觉数据表示:研究者们将所有类型的视觉数据转换为统一的表示,以便进行大规模的生成模型训练。Sora 使用视觉补丁(patches)作为其表示方式,类似于大型语言模型(LLM)中的文本标记。

视频压缩网络:研究者们训练了一个网络,将原始视频压缩到一个低维潜在空间,并将其表示分解为时空补丁。Sora 在这个压缩的潜在空间中进行训练,并生成视频。

模型:Sora 是一个扩散模型+Transformer,它通过预测原始“干净”的补丁来从输入的噪声补丁中生成视频。扩散模型在语言建模、计算机视觉和图像生成等领域已经显示出了显著的扩展性。

视频生成的可扩展性:Sora 能够生成不同分辨率、时长和宽高比的视频,包括全高清视频。这种灵活性使得 Sora 能够直接为不同设备生成内容,或者在生成全分辨率视频之前快速原型化内容。

语言理解:为了训练文本到视频生成系统,需要大量的视频和相应的文本标题。研究者们应用了在 DALL·E 3 中引入的重新描述技术,首先训练一个高度描述性的标题生成器,然后为训练集中的所有视频生成文本标题。

图像和视频编辑:Sora 不仅能够基于文本提示生成视频,还可以基于现有图像或视频进行提示。这使得 Sora 能够执行广泛的图像和视频编辑任务,如创建完美循环的视频、动画静态图像、向前或向后扩展视频等。

模拟能力:当视频模型在大规模训练时,它们展现出了一些有趣的新兴能力,使得 Sora 能够模拟物理世界中的某些方面,如动态相机运动、长期一致性和对象持久性等。

小结

尽管 Sora 展示了作为模拟器的潜力,但它仍然存在许多局限性,例如在模拟基本物理交互(如玻璃破碎)时的准确性不足。OpenAI认为持续扩大视频模型的规模,将可以用来模拟整个物理和数字世界,毕竟它们纯粹是尺度的现象(they are purely phenomena of scale)。 顺着这个方向发展,或许LLM真的能够成为世界模型!

暂无评论内容