然而事实情况是,小米并没有放弃AI。甚至,在小米技术的推动下,有可能肝出开源版的Sora。

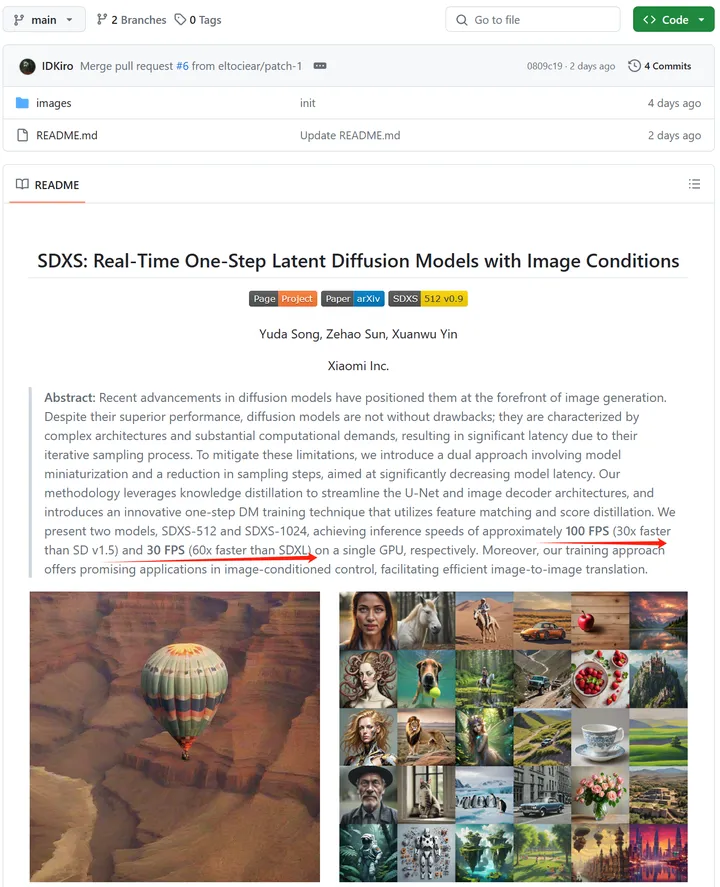

最近小米放出来一个叫做SDXS的大模型,这个大模型最大的特点,就是快,快到匪夷所思。

玩AI绘画的,都喜欢stable diffusion,因为它的开源。

在开源社区的努力下,这个工具越来越强大(虽然StableAI公司不断的有创始人出走),中国人在SD的发展中做出了巨大的贡献。

为了提高SD的出图速度,清华团队开发出来LCM技术,被很多大模型创作者采用,出图开始进入秒级时代。

字节又推出了画质损失极小的Lightning技术,出图速度比LCM还要快一些的情况下,画质更优。

而小米的SDXS就非常离谱了,LCM和Lightning能做到几秒一张,而SDXS可以一秒100张!!!

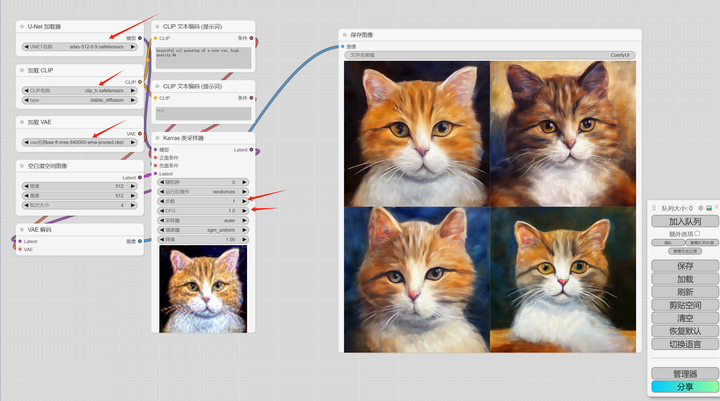

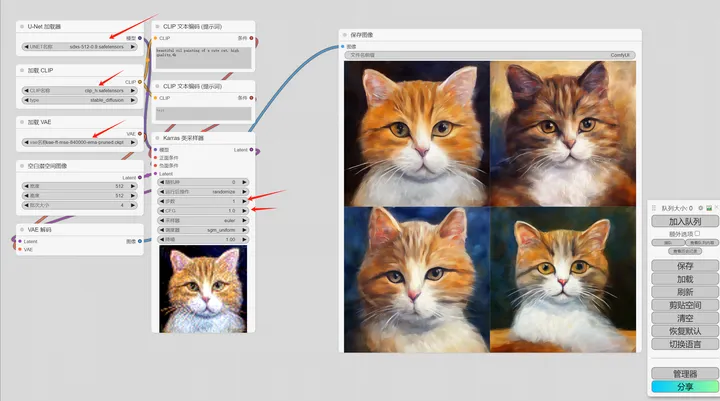

为了让大家直观的感受SDXS的速度,我做了一个视频,从点下按钮到生成4张图片,几乎没有消耗时间(工作流有解析文字的时间),生图是秒级的。

我的显卡是12G的3060。

00:12

现阶段画质略差一些,但用来做视频是完全没问题的。

当我们可以每秒生成上百张高质量图片的时候,这意味着,秒级生成视频不再有难度,开源版的Sora已经近在咫尺了。

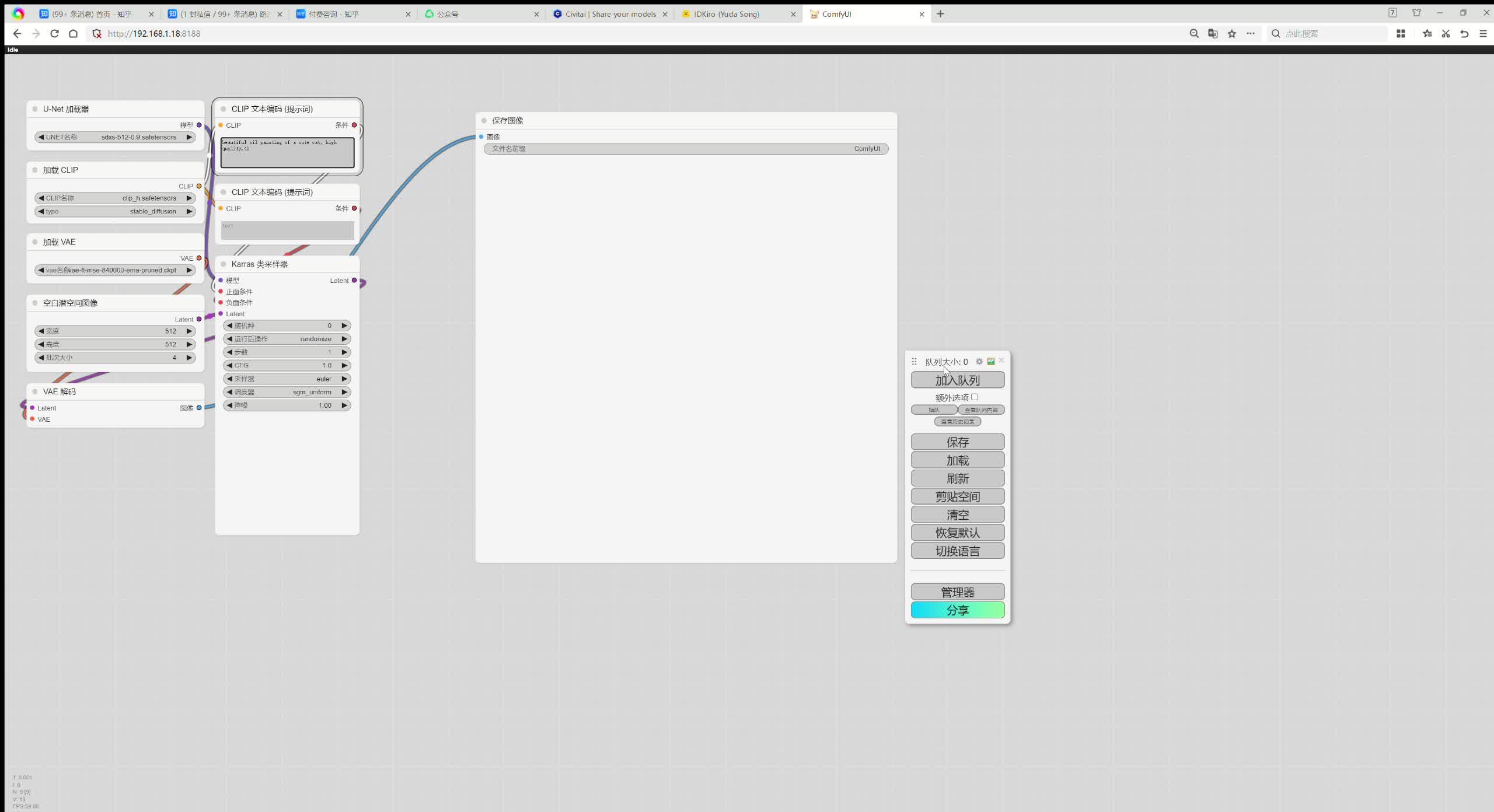

目前最新版的comfyUI已经支持SDXS大模型,具体使用方式如下:

一、下载SDXS用到的三个模型

1、UNET模型

网盘下载

https://www.123pan.com/s/ueDeVv-ZbuI.html

模型安装至comfyUI\models\UNET

2、clip模型

网盘下载

https://www.123pan.com/s/ueDeVv-bbuI.html

模型安装至 comfyUI\models\clip

3、vae模型

网盘下载

https://www.123pan.com/s/ueDeVv-cbuI.html

模型安装至comfyUI\models\vae

二、下载工作流

网盘下载

https://www.123pan.com/s/ueDeVv-ebuI.html

三、工作流中的模型配置

1、unet模型,选择sdxs-512-0.9.safetensors

2、clip模型,选择clip_h.safetensors

3、vae模型,选择840000那个

尺寸选512*512(当前的模型其他尺寸效果较差,坐等新模型后续发布),步数选1,CFG选1,然后输入提示词就可以生成图片了!

暂无评论内容