面部衰老是一个复杂的过程,受到性别、种族、生活方式等多种因素的影响,这使得在全球范围内预测个体的衰老过程变得非常困难。现有的技术虽然能生成看起来真实的衰老效果,但这些衰老后的图像往往无法准确呈现一个人在目标年龄时的真实模样,因此需要进行个性化调整。在虚拟衰老的实际应用中,比如电影和电视特效制作,通常可以使用用户的个人照片集,这些照片记录了用户在短时间内(20到40年)发生的衰老变化。

为了解决这个问题,北卡罗来纳大学提出了MyTimeMachine(MyTM)方法,它结合了全球衰老模型和用户个人的照片集(最多只需要50张图片),来学习个性化的衰老效果。该方案不仅适用于静态图像,还可以扩展到视频,生成高质量、保持身份特征且时间一致的衰老效果,能够更准确地呈现目标年龄时的真实外貌,且效果优于现有的最先进方法。

01 技术原理

—

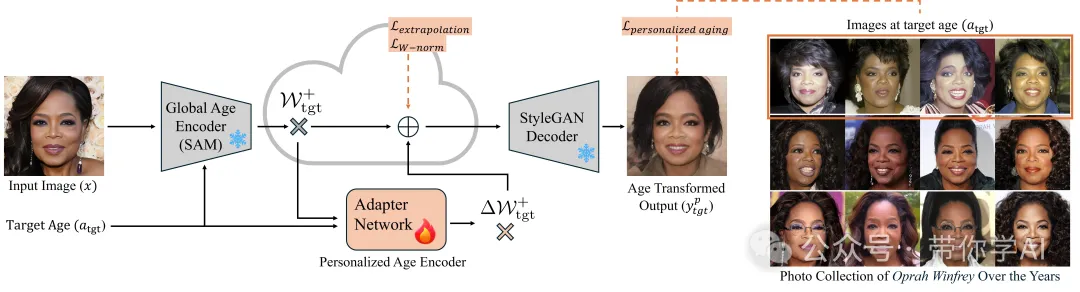

通过一个适配器网络,将输入的70岁面部图像重新调整为看起来像30岁的样子,同时保持原图的风格。为了实现个性化的重龄化,收集了一个人在不同年龄段的50张照片,并训练了一个适配器网络,用来更新全局年龄编码器SAM生成的潜在代码。当目标年龄在训练数据中出现的年龄范围内时,适配器能够很好地保持身份特征;而当目标年龄超出训练数据范围时,它也能较好地推测出新的年龄。

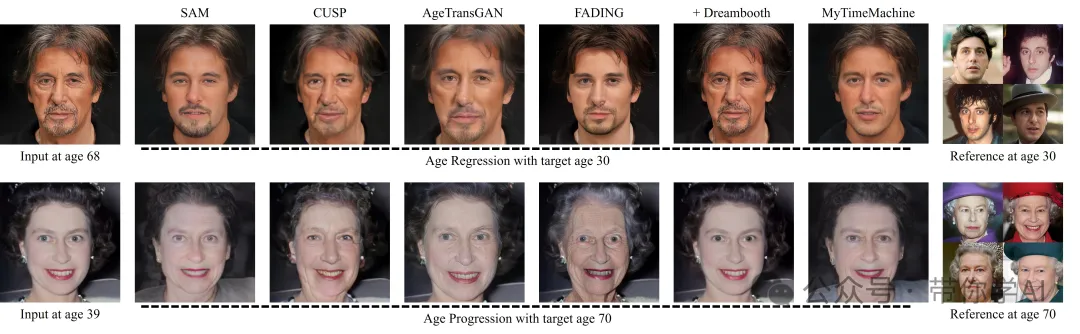

通过训练一个专属于个人的年龄模型,来实现个性化的年龄回退(下图上部分)和年龄增长(下图下部分)。这个模型仅需大约50张跨越20到40年间的个人照片就能完成。

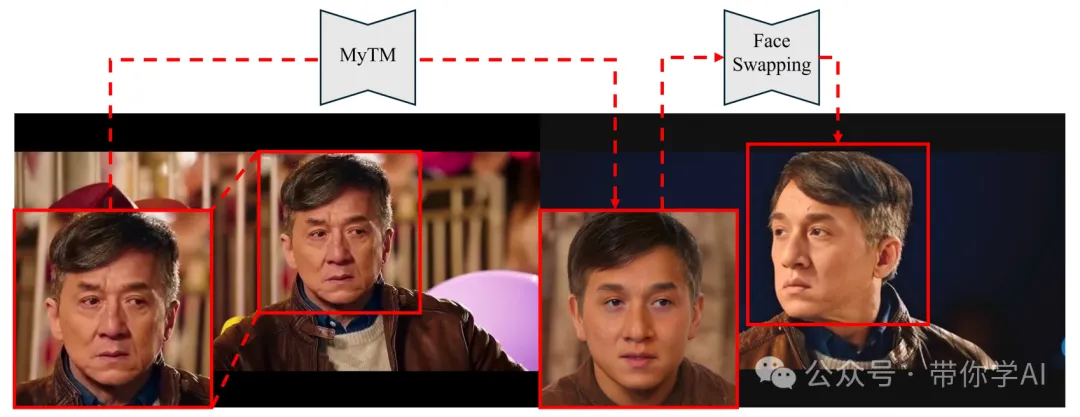

对电影《机器之血》中的成龙视频进行重龄化处理。左边:是MyTimeMachine技术进行重龄化处理的源视频中的关键帧。右边:经过重龄化的面部图像被通过换脸技术映射到源视频的其他帧上。

02 对比与实际效果

—

年龄变换技术的表现对比:第一两行展示了年龄回退(年龄变小),最后两行展示了年龄增长(年龄变大)。第一列是输入的图像,第二列是同一个人在目标年龄的参考图像。MyTimeMachine与其他最先进的方法进行了比较,包括SAM、CUSP、AgeTransGAN和 FADING。

局限性:1)难以将头发颜色修改为白色或从白色修改回来—这是其他年龄变换工作中常见的挑战;2)在生成老年面孔时可能会产生红眼现象。

暂无评论内容