智谱在近期发布的若干更新模型,以基座大模型 GLM-4-Plus 推出为标志。智谱很高兴宣布,全模型家族正式上线bigmodel.cn,包括新基座大模型 GLM-4-Plus,这是智谱迄今为止最强大的模型,成为智谱全模型家族坚实的能力底座。

此外,本次还新上线了视频通话 API:GLM-4-Plus-VideoCall,它是清言视频通话背后的模型,可以实现视频通话、语音多轮交互等多种跨模态能力,该能力可能是推动人机交互的革新范式。

01

新基座大模型 GLM-4-Plus

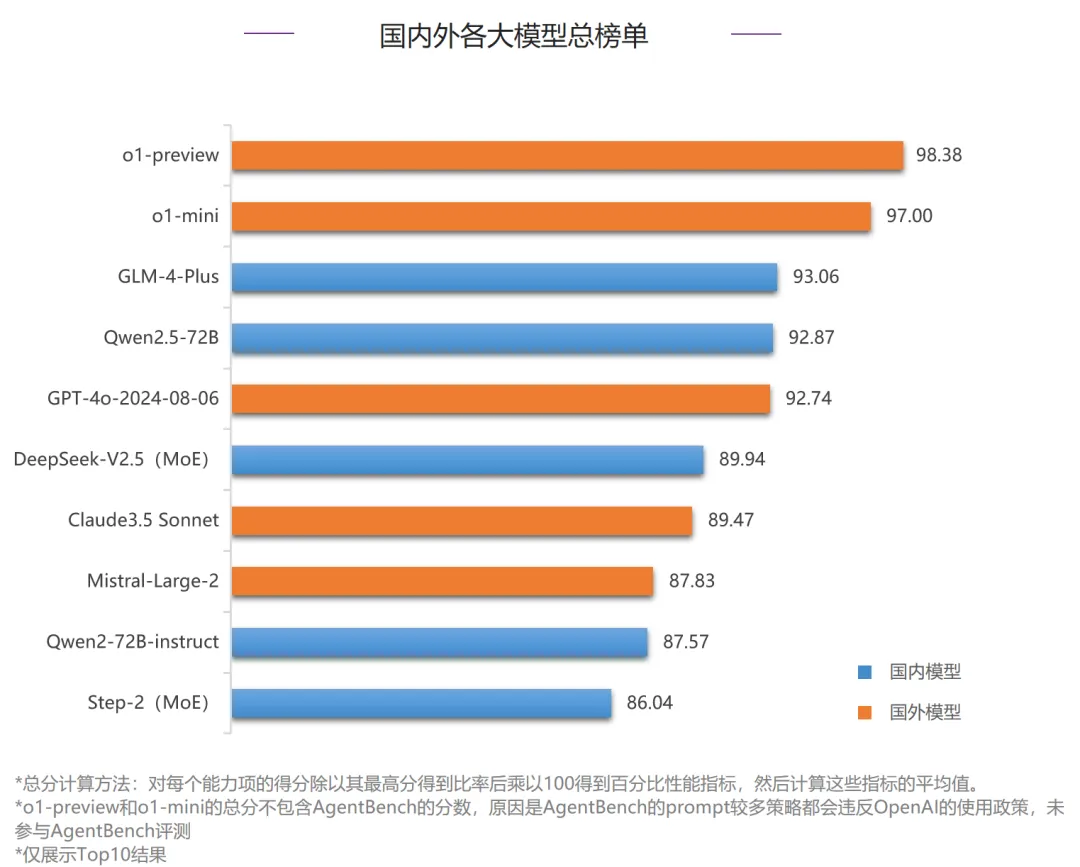

GLM-4-Plus 在各大语言文本能力数据集上获得了与 GPT-4o 及 405B Llama3.1 相当的水平。作为智谱最新旗舰模型,在语言理解、逻辑推理、指令遵循、长文本输出方面都有较大突破。在最新的 SuperBench 大模型评测中,GLM-4-Plus 位列世界前三,打破此前国外模型垄断前三甲的局面。

新基座大模型 GLM-4-Plus 成为智谱全模型家族坚实的能力底座,在代码计算、数据分析、图像/视频特征识别等领域均实现性能的大幅提升,及成本的大幅下降。内测期间,来自金融、互联网、企服、教育等各行业伙伴用 GLM-4-Plus,完成信息抽取、机器翻译、智能体辅助教育等不同的任务。

案例1:机器翻译

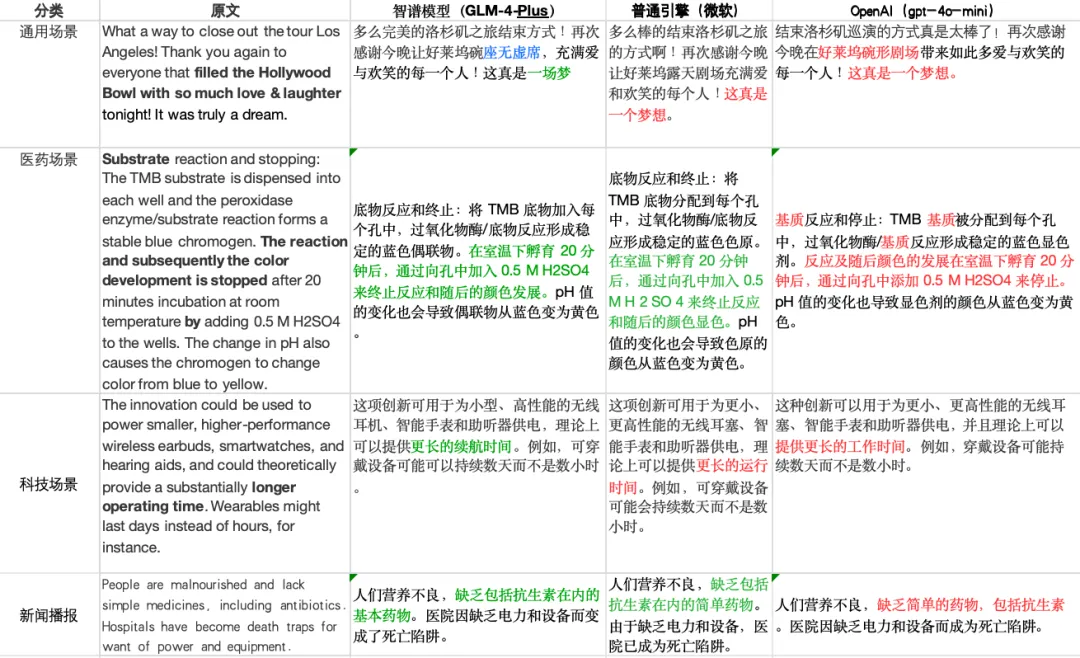

翻译任务既需要对语义有精准的理解,也需要良好的目标语言的生成能力。同时,翻译场景经常对响应速度有极高的要求。GLM-4-Plus 系列语言模型在保持了高效响应和快速tokens输出的同时,对垂直行业、国际新闻和科技信息等多个场景都体现了准确的翻译能力。下表列举 GLM-4-Plus 对比微软和 GPT-4o-mini 的翻译效果(绿色为翻译准确):

案例2:AI 颠覆传统游戏 NPC

国庆期间 B 站 UP 主林亦 LYi 让 6 个 AI 智能体“住”进了同一套公寓,这个中文加强版的「斯坦福小镇」,还带点儿 AI 版《老友记》的搞笑剧情,让游戏真正达到了 AI Native 的体验,引来百万网友驻足围观。这些 AI 的“大脑” 来自开放平台的API,其中「能力拉满」的 GLM-4-Plus 驱动智能体完成日常的复杂思考任务。例如要 AI 完成一整天的日程计划,具备处理大量信息的能力,且能够主动思考和反馈。

下一代的开放世界已经来到我们身边

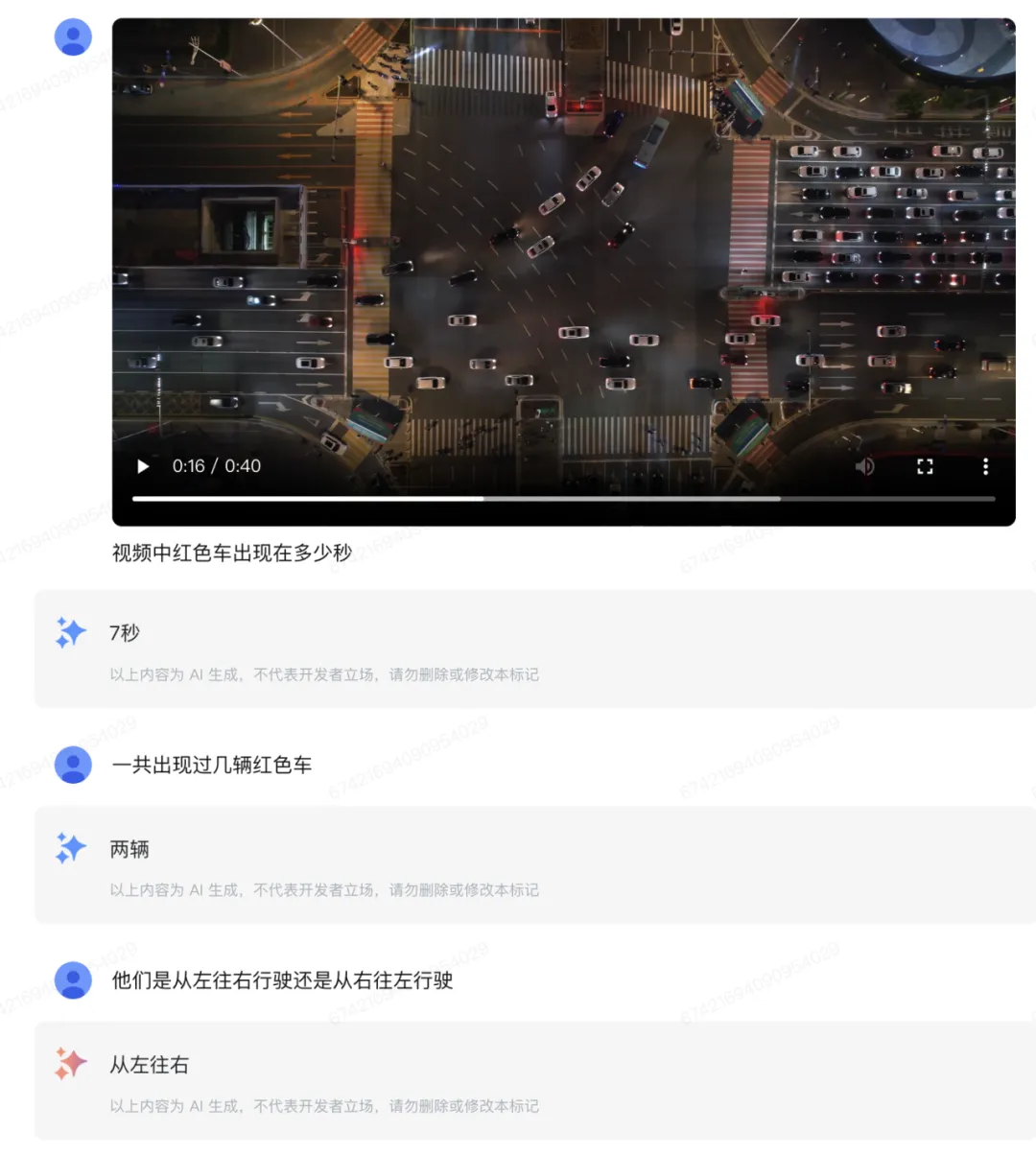

案例3:时序问答和多轮对话

在数十秒的视频中,GLM-4V-Plus 可以准确理解并感知时间,精准定位到事件发生的时刻,同时也可以针对单个视频进行多轮对话问答,在视频理解的基础上结合上下文理解指代问题(他们->两辆红色车),进行更丰富的任务处理。

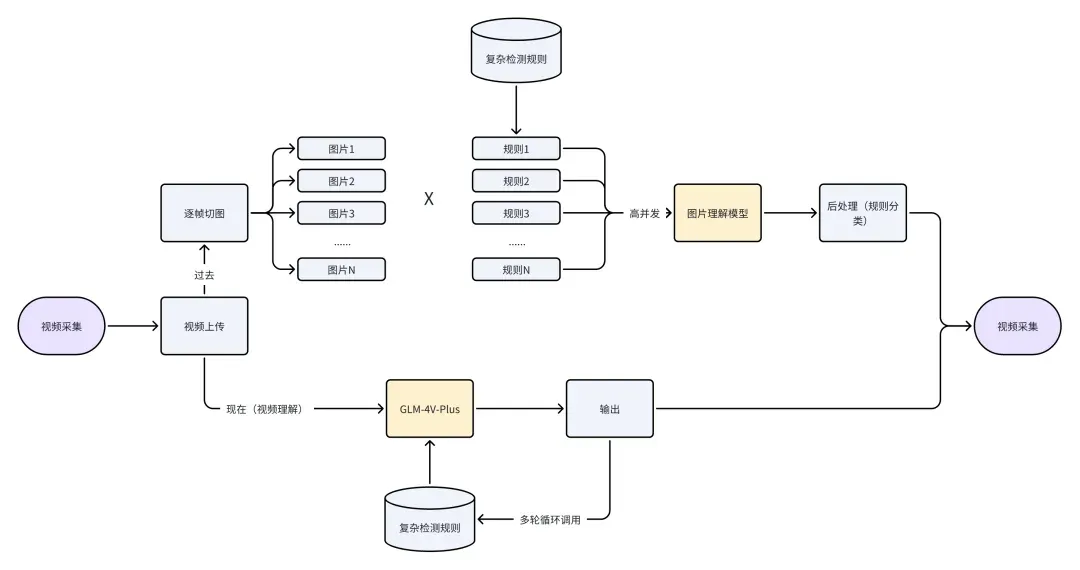

从单一图像识别进步到 GLM-4V-Plus 视频/图像理解,能解决原先需要将视频逐帧抽象为图片、再进行二次图片理解与识别的高昂成本。同时 ,GLM-4V-Plus 更复杂的 prompt 处理及多轮对话能力能并行处理多个任务。

GLM-4V-Plus 实现的智能检测系统架构

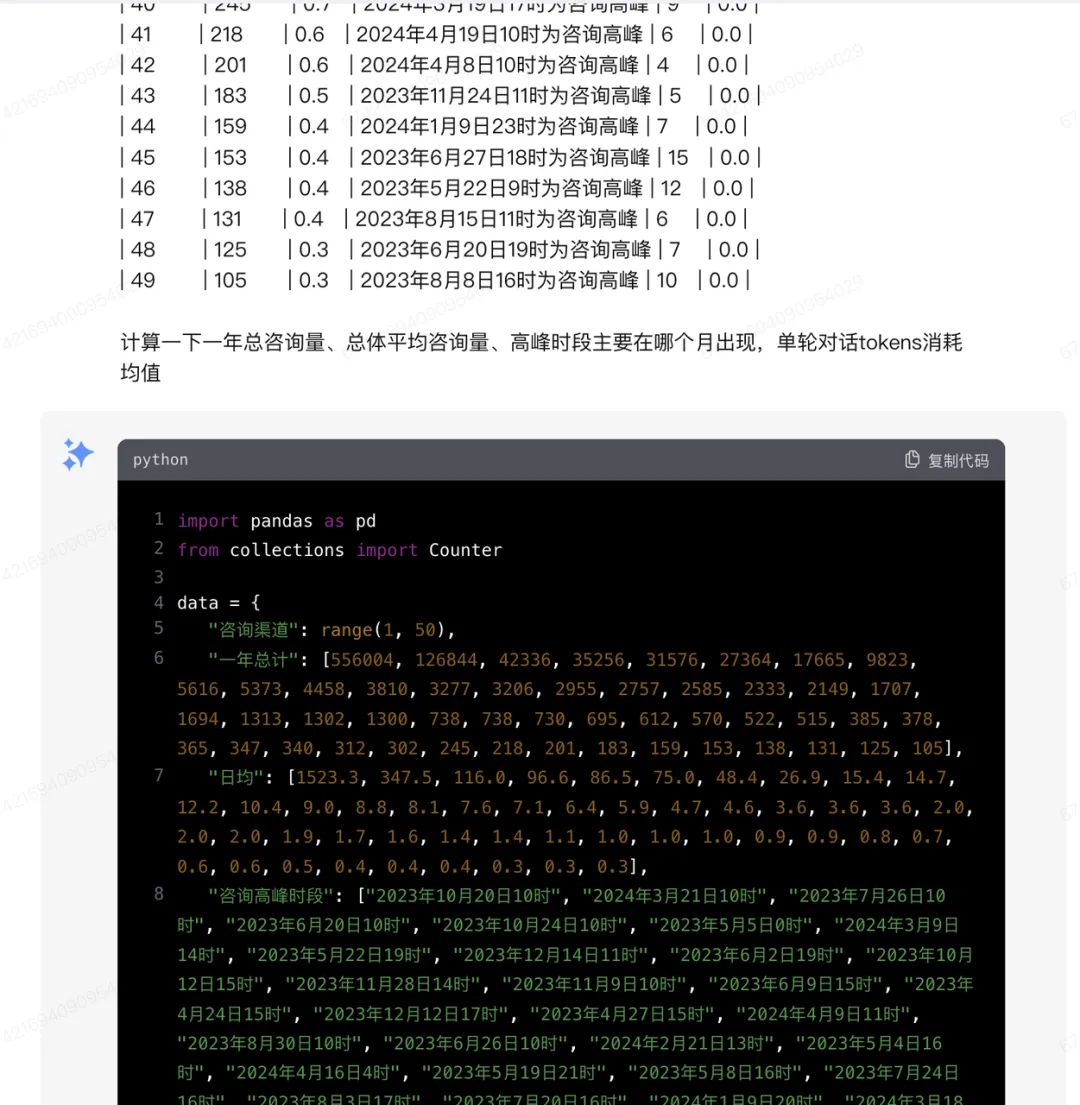

案例4:数据分析任务

在常见的数据分析任务中,GLM-4-Plus 也可以很好的代替数据分析师进行初始代码生成、并执行获得结果,较大提升数据分析师进行数据分析任务的效率。

02

GLM-4-Plus-VideoCall:

上线开放申请

许多用户在清言 App 上第一次体验到了 AI 有眼睛看到世界的惊奇表现,这背后是智谱多模态模型能力的支持,让 AI 具备跨文本、音频、视频的实时推理能力,让大模型在应用层交互上变得更加便捷亲切。即日起,GLM-4-Plus-VideoCall(清言的视频通话)上线开放平台开放申请,这种人与机器交互的范式革新,将拓展大模型应用想象力的边界,在更多场景中解锁魔法。

暂无评论内容